ローカルLLM

ローカルLLM 2026年版!Claude CodeとOllama連携でローカルLLMの可能性が広がる徹底解説

2026年最新情報!Claude CodeとOllamaの連携でローカルLLMの可能性が広がる。開発者向けにコード生成精度向上とプライバシー保護の両立が実現。詳しくはこちら→

ローカルLLM

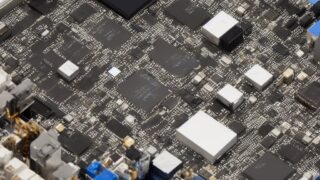

ローカルLLM  ハードウェア

ハードウェア  ハードウェア

ハードウェア  ハードウェア

ハードウェア  ローカルLLM

ローカルLLM  ローカルLLM

ローカルLLM  ローカルLLM

ローカルLLM  ローカルLLM

ローカルLLM  ローカルLLM

ローカルLLM  画像生成AI

画像生成AI